AI Act : ce qui change le 2 août 2025 pour les chatbots et l’e-commerce

En bref — Le Règlement européen sur l’intelligence artificielle (AI Act) avance à marche forcée : depuis février 2025, les usages jugés « inacceptables » (notation sociale, manipulation comportementale, reconnaissance biométrique en temps réel) sont interdits. Le 2 août 2025, les nouvelles règles visant les modèles d’IA générative (GPAI) s’appliquent, avant la mise au pas complète des systèmes « haut risque » prévue pour août 2026. Pour les équipes relation-client et e-commerce — qui s’appuient sur des chatbots et moteurs de recommandation — ces échéances passent d’une contrainte juridique à une question de confiance, de réputation et, in fine, de chiffre d’affaires.

Un calendrier serré qui rebat les priorités

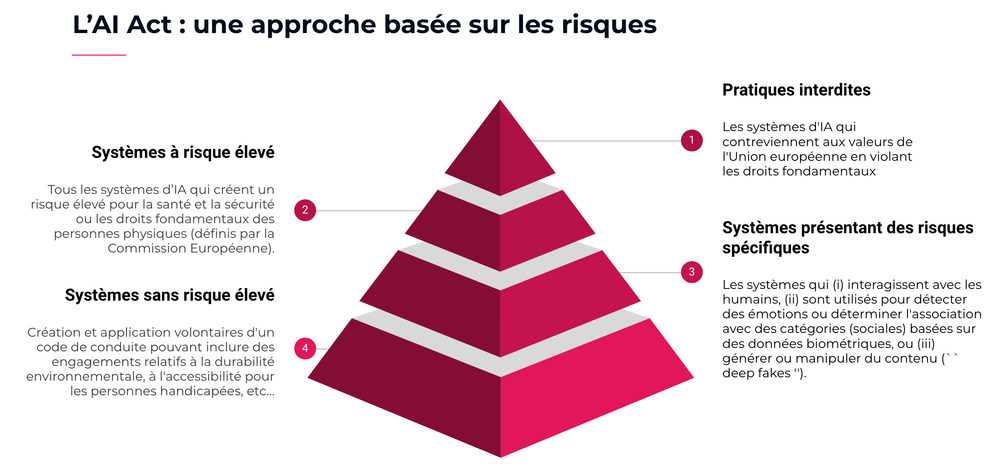

Le règlement est en vigueur depuis le 1ᵉʳ août 2024 et se déploie par paliers jusqu’en 2027, selon quatre niveaux de risque. La page officielle Implementation Timeline liste trois dates charnières : 2 février 2025 (interdiction des pratiques « inacceptables »), 2 août 2025 (obligations GPAI et barème d’amendes), 2 août 2026 (conformité totale des systèmes « haut risque »).(Artificial Intelligence Act) Bruxelles a confirmé qu’il n’y aurait « ni pause ni report » malgré les demandes des géants du numérique.

De l’interdiction au devoir de transparence

Les pratiques bannies par l’article 5 couvrent tout dispositif capable de manipuler ou d’exploiter des publics vulnérables, ainsi que la reconnaissance biométrique temps réel dans l’espace public.(Inside Privacy) Conserver l’une de ces fonctions expose déjà à la sanction maximale.(Artificial Intelligence Act)

2 août 2025 : coup d’envoi pour l’IA générative

Dès cette date, tout nouveau GPT-5, Claude-4, Gemini-2 ou équivalent devra publier une documentation technique détaillée et un résumé public des données d’entraînement, et tenir un registre de risques communiqués à la future AI Office. Les articles 53 et 55 imposent aussi un reporting d’incidents graves et offrent la possibilité d’adhérer au Code de pratique GPAI pour prouver sa « bonne foi ». Les modèles commercialisés avant août 2025 bénéficient, sauf refonte majeure, d’un sursis jusqu’au 2 août 2027.

Pourquoi la relation client et l’e-commerce sont en première ligne

Un chatbot inséré dans un parcours d’achat fait de vous un intégrateur : vous devez exiger des preuves de conformité à vos fournisseurs API/cloud et contractualiser la non-réutilisation des données clients. Chaque décision automatisée (ex. refus de remboursement ou scoring d’éligibilité) doit être explicable et ouvrable à contestation humaine, conformément à l’article 86. Mieux : l’utilisateur doit voir une mention claire indiquant qu’il dialogue avec une IA, comme l’impose l’article 50. Autant d’exigences qui, si elles ne sont pas anticipées, créent des frictions dans le tunnel de vente et font fuir les clients.

Gouverner l’IA en interne : cartographie, formation, contrôle

La CNIL rappelle qu’un simple usage de GPT en back-office nécessite une cartographie des outils, une évaluation RGPD/AI Act et une charte interne mise à jour.(CNIL) Les équipes doivent être formées aux biais et hallucinations pour éviter fausses promesses, conseils inadaptés ou fuites de données. La surveillance continue du système et l’arrêt en cas de dérive sont exigés par l’article 26.

Cap sur août 2026 : l’ère des systèmes « haut risque »

Les bots dédiés au scoring de crédit, au recrutement ou au conseil médical basculeront alors sous le régime « haut risque ». Ils devront conserver des journaux d’évènements pendant six mois, faire l’objet d’audits réguliers et rester sous supervision humaine qualifiée.

Sanctions et réputation : le double coup de massue

Le non-respect des pratiques interdites expose à 35 M € ou 7 % du CA mondial ; une non-conformité GPAI ou « haut risque » coûte jusqu’à 15 M € ou 3 % selon l’article 99. (Artificial Intelligence Act) Au-delà des chiffres, un chatbot discriminant ou une fuite de données peut briser la confiance client et déclencher une tempête médiatique, comme le souligne Reuters quand elle rappelle que l’UE « ne ralentira pas ».

Transformer la contrainte en avantage concurrentiel

La marche à suivre est simple : inventorier vos usages IA, classer chaque cas selon le niveau de risque, documenter vos modèles et jeux de données, mettre à jour les contrats fournisseurs, et former en continu vos équipes. Les marques qui s’y prennent tôt transforment un texte de loi en promesse de transparence, de fiabilité et de respect des droits — autant d’atouts pour une expérience client durablement différenciante.

![[Mai 2025] Assistance client IA : comment les agents intelligents révolutionnent l'expérience client](https://cdn.prod.website-files.com/608c31821ca313c132ba699e/682c97ca8c8cae918362954a_Design%20sans%20titre.png)